A sua palestra inspiradora resumiu a evolução da Deep Learning até aos atuais modelos linguísticos de grande dimensão (LLM), como o ChatGPT, salientando ao mesmo tempo os desafios e as potencialidades que nos esperam nos próximos anos.

Extensão de LLMs a dados de imagem

Por um lado, esta abordagem resolve o problema do texto limitado, uma vez que existem muito mais dados de imagem do que de texto. Por outro lado, as imagens podem ser facilmente geradas através da observação do mundo real, enquanto os textos só podem ser escritos por humanos. À semelhança dos LLMs, Yann LeCun espera a emergência de um "Foundation Model", ou seja, um modelo que constrói um conhecimento emergente do mundo das imagens e que pode ser facilmente "refinado" para aplicações específicas.

Redes hierárquicas para planificar o pensamento

A nossa conclusão

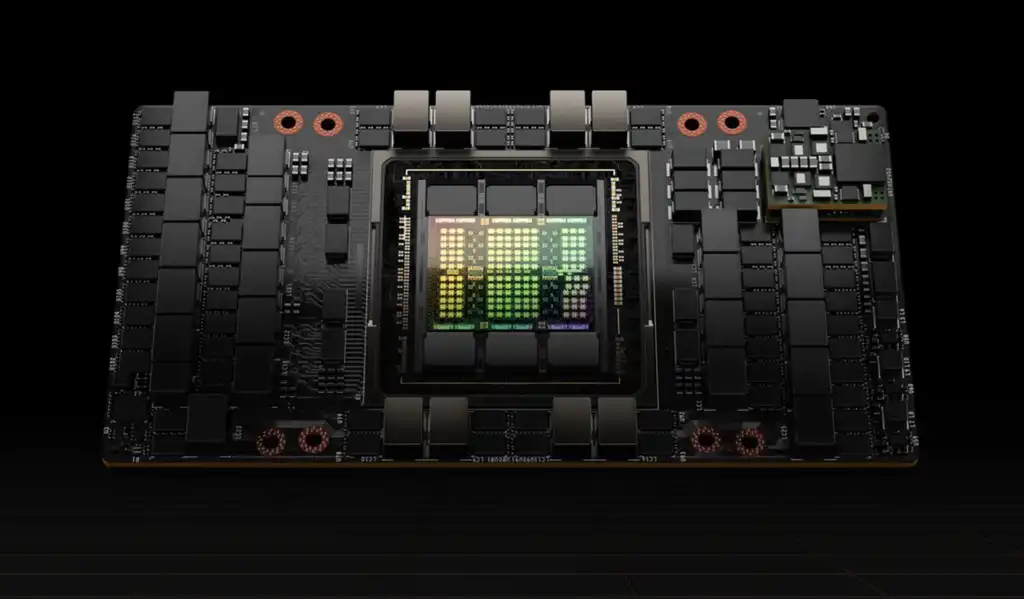

Com as nossas novas GPUs nVidia H100, no CIB group estamos numa posição ideal para compreender e avaliar essas questões no nosso departamento de investigação e para as utilizar da melhor forma nos nossos produtos.