Su inspiradora charla resumió la evolución desde el Deep Learning hasta los grandes modelos lingüísticos (LLM) actuales, como ChatGPT, al tiempo que destacó los retos y potenciales que nos esperan en los próximos años.

Extensión de los LLM a los datos de imagen

Por un lado, este enfoque resuelve el problema del texto limitado, ya que hay muchos más datos de imágenes que de texto. Por otro, las imágenes pueden generarse fácilmente observando el mundo real, mientras que los textos sólo pueden escribirlos los humanos. Al igual que los LLM, Yann LeCun espera la aparición de un "Foundation Model", es decir, un modelo que construya un conocimiento emergente del mundo de las imágenes y pueda "refinarse" fácilmente para aplicaciones específicas.

Redes jerárquicas para planificar el pensamiento

Nuestra conclusión

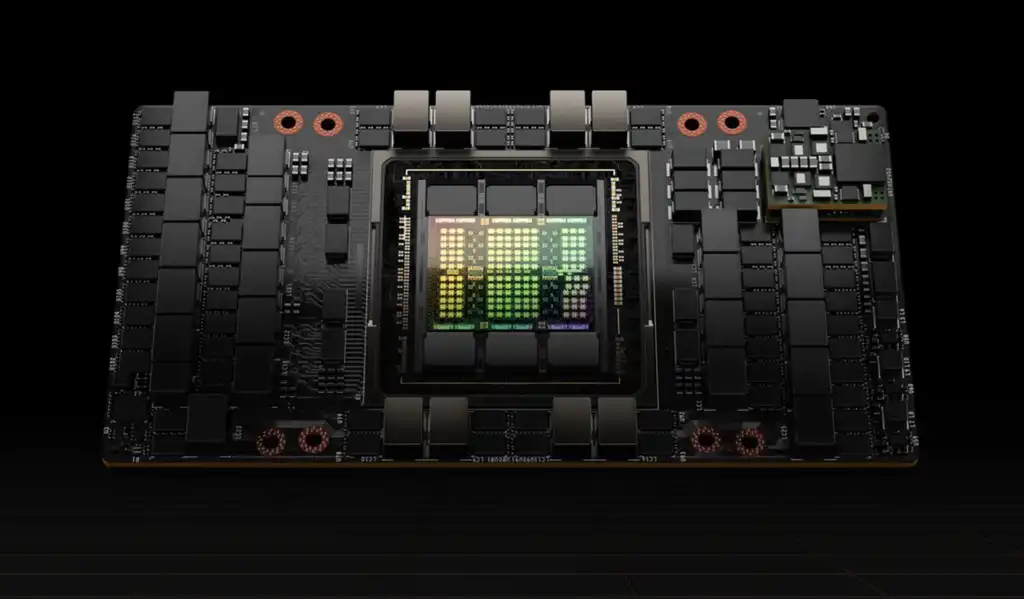

Con nuestras nuevas GPU nVidia H100, en CIB estamos en una posición ideal para comprender y evaluar estos aspectos en nuestro departamento de investigación y sacar el máximo partido de ellos en nuestros productos.